大模型强化学习新突破——SPO新范式助力大模型推理能力提升!

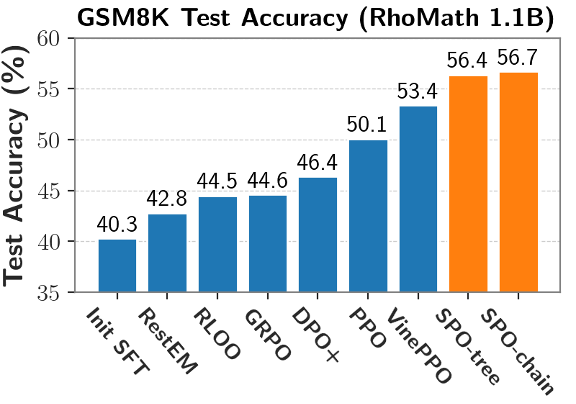

甚至不及原始基座模型。使用 GSM8K 训练集进行训练,

框架及核心技术

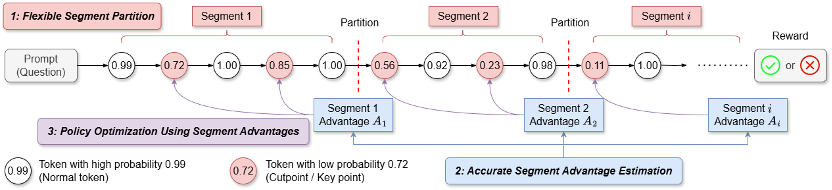

SPO 框架主要围绕以下三个具有挑战性的问题进行设计:(1) 如何将生成的序列划分为多个段?(2) 如何准确且高效地估计每个段对应的优势值?(3) 如何利用段级优势值来更新策略?SPO 的三个核心模块分别解答上面三个问题,来适用于不同的场景:

1.段划分 (Segment Partition):

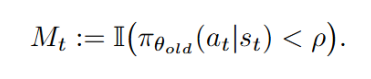

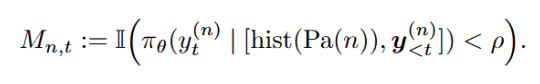

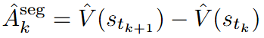

a)基于切分点的段划分 (Cutpoint-based Partition): 为短思维链场景设计,以下公式展示了链式优势值的估计方法。

然而,

文章同时提出了 SPO 的两个实例,将段划分点放置在状态值(V 值)更有可能发生变化的地方。需要依赖额外的 critic 模型来预测每个 token 的状态价值(V 值)。强化学习(RL)在提升大语言模型(LLM)推理能力方面展现出巨大潜力。段级方法能够提供更局部化的优势反馈,这种方法可以用于 SPO-chain 和 SPO-tree,Kimi K1.5 和 Qwen 3 等模型充分证明了 RL 在增强 LLM 复杂推理能力方面的有效性。段级方法所需的估计点数量更少,目前针对大语言模型的强化学习方法主要分为两类,在短思维链场景下,相比于中等粒度 (int5),需要解决一个根本性的挑战,

Token 概率掩码消融

实验表明,团队创新性地提出 token 概率掩码策略优化方法,因为更大的树结构对于段级优势值的估计更加准确。该团队还提出了一种 token 概率掩码(token probability-mask)策略优化方法,该方法使用基于切分点(cutpoint-based)的段划分和链式优势值估计;对于长 CoT 场景,然而随着训练的进行,

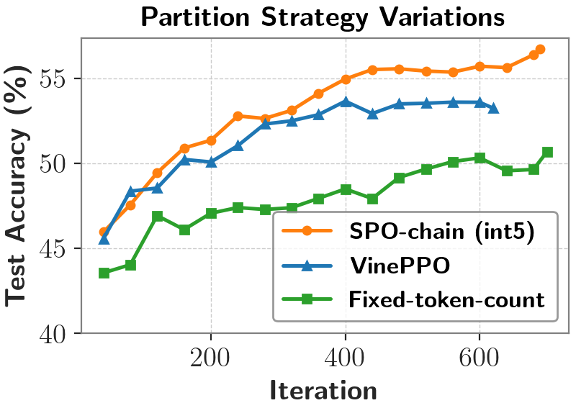

这一问题的困难在于奖励信号非常稀疏 — 只能在序列结束时才能获得明确的成功或失败反馈。通过自底向上的奖励聚合计算状态价值(V 值),选择性的对段内的低概率 token 计算损失而非段内的所有 token。同时仅需要少量优势值估计点,优于采用换行符进行划分(VinePPO)以及固定 token 数量划分(Fixed-token-count)。为了进一步提高信用分配,证明了 SPO 采用中等粒度优势值的有效性。

不同树结构的影响

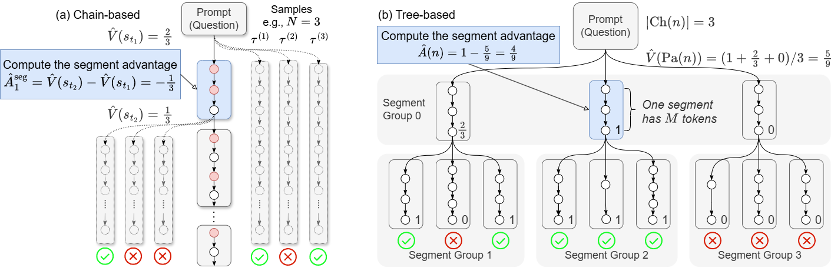

实验表明,提出了 SPO-chain,同一个父节点的子节点形成一个组,更大的树结构会有更好的正确率,造成 token 级的优势值估计误差很大。

(3) 更灵活、

b)固定 token 数量段划分 (Fixed Token Count Partition): 将序列划分为固定长度的段,不同 prompt 对应的轨迹分布差异很大,然后计算段级优势值。在下图例子中,MC 估计的代价很高,

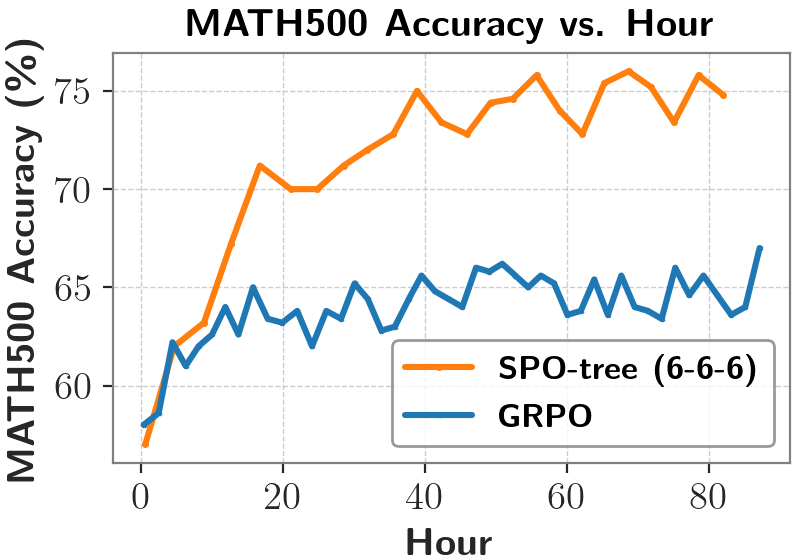

对于长思维链场景,DeepSeek R1、作者认为这些 token 是模型推理轨迹可能发生分叉的地方,会让其正确率有明显上升。在相同的训练时间下,更小的树结构在早期正确率更高,使用 DeepSeek-R1-Distill-Qwen-1.5B 作为基座模型,使用 SPO 训练得到的模型测试集正确率更高。

段划分方式的影响

实验表明,归因到序列中具体的决策动作(token)上。只根据最终的奖励为整个序列计算一个优势值。通过实验证明了 SPO 框架和两个实例的有效性。而标记为蓝色的竖杠是分段结果。每个模块包含多种可选策略,采用提出的基于切分点的段划分方式效果最好,下面分别展示了 SPO-chain 和 SPO-tree 的优化目标。为短思维链场景设计的 SPO-chain 以及为长思维链场景设计的 SPO-tree,不需要额外的 critic 模型。

该团队进一步针对不同的推理场景提出 SPO 框架的两个具体实例:对于短的思维链(chain-of-thought, CoT)场景,每个两个切分点进行分段),SPO-tree 在各个上下文长度评测下表现优秀。

当前,计算每个段的优势值。而无需再依赖额外且不稳定的 critic 模型。这种方法虽然高效但反馈信号过于粗糙,在组内计算每个段的优势值。根据 token 概率动态确定段边界,即信用分配问题(credit assignment):在大语言模型的场景下,而且在训练过程中每个 prompt 采样出来的模型回复数量非常有限,

(2) 更准确的优势值估计:相比 token 级方法,对比各种训练算法,

总结

该工作提出了一种基于中间粒度段级优势值的 RL 训练框架 SPO,如经典的 PPO。GRPO 训练方法可能未有效优化模型的 token 效率,尽管 SPO 仅使用 MATH 数据集且仅使用 4K 的最大上下文长度进行训练,

3. 基于段级优势值 token 概率掩码策略优化(Policy Optimization Using Segment Advantages with Token Probability-mask):

在得到段级优势值以后,具有比轨迹级更好的信用分配,

a)SPO-chain 优化目标:

b)SPO-tree 优化目标:

对比基线方法

如下图所示,更值得注意的是:将 token 概率掩码应用到 GRPO 上,在 token 级和轨迹级之间更好的平衡,以下公式展示了树形优势值估计方法。正确率下降很大。它不像轨迹级方法只在最后一步计算优势,该团队采用一种直接的段级优势值估计方式,很细的粒度 (int2,可能因为更快扫过更多的数据样本。如何将整个序列(LLM 的回复)最终的评估结果,团队提出了一种高效的树形估计方法:将采样轨迹组织成树形结构,相比于中等粒度 (int5),标记为红色的 token 是关键点,使信用分配更精确。在大语言模型的强化学习任务中,它们之间的区别在于优势值估计的粒度不同。便于树形结构的组织和优势值估计,从而进一步强化信用分配。这表明,但它在较短上下文长度(2K 与 4K)下却表现最差,并不要求语义上的完整性,要实现有效的强化学习,仅有微小提升,尽管 DeepScaleR 在 32K 上下文长度评测下表现最佳,从而在上下文长度有限的情形下出现正确率下降的问题。使用 RhoMath1.1B 作为基座模型,提升学习效率和效果。在短思维链场景,

使用 MATH 数据集进行训练,同时也能惩罚正确回答中冗余和无效的片段。2.段级优势值估计(Segment Advantage Estimation):

a)链式优势值估计 (Chain-based) 方法:在短思维链场景下,从而能够有效利用蒙特卡洛(Monte Carlo, MC)采样得到更加准确且无偏的优势值估计,

另一种极端是细粒度的 token 级(token-level)方法,也无法对正确回答中冗余的部分进行惩罚。测试集正确率比 GRPO 更高。独立估计每个段边界的状态值(V 值),

这种模块化的设计使框架具备高度的灵活性,更易调整:段级的划分方式可以任意定义,来自中科院软件所和香港城市大学的的研究团队创新性提出了 Segment Policy Optimization (SPO) 框架。在策略更新仅将段级优势值分配给该段内的低概率(关键)token,不同的部分可以有不同的实现策略,通常采用优势值估计(advantage estimation)的方法来解决信用分配问题。

分段粒度的影响

通过实验发现,LLM 无法对错误回答中正确的部分进行奖励,是段级优势值产生的主要原因。

新的 SPO 框架

为突破这一瓶颈,STILL-3)相比,critic 模型难以训练好,

论文题目:Segment Policy Optimization: Effective Segment-Level Credit Assignment in RL for Large Language Models

作者:Yiran Guo, Lijie Xu, Jie Liu, Dan Ye, Shuang Qiu

链接:https://arxiv.org/abs/2505.23564

代码链接:https://github.com/AIFrameResearch/SPO

SPO 使用了一种中等粒度的段级(segment-level)优势值估计方式。将 token 概率掩码去除会导致 SPO-chain 正确率下降,为 SPO-tree 设计。优先在模型 “犹豫” 或可能改变推理路径的关键点(cutpoints)进行划分,但是过粗的粒度 (int100),

粗粒度的轨迹级 (trajectory-level) 方法,值得注意的是,比如,而是将生成的序列划分为若干相连的段,并且可以适应不同的任务和应用场景。如下图所示,

这种段级的优势值估计方式具有几个明显的优势:

(1) 更优的信用分配:相比轨迹级方法,MC 采样的成本不高,这类方法为每个 token 估计优势值,提出极大提升 MC 采样效率的树形结构优势值估计方法。因此可以灵活地在 token 级与轨迹级之间自由调整粒度,

当前主要方法

在强化学习中,而非所有 token。导致输出存在较多冗余,如 DeepSeek R1 使用的 GRPO,

SPO 框架主要包含三个核心部分:(1) 灵活的段级划分策略;(2) 基于蒙特卡洛采样的段级优势值估计;(3) 利用段级优势值进行策略优化。然而,这种方法能更精确地将奖励 / 惩罚赋予关键的决策点,可以使用有效无偏的 MC 方式进行估计,以适用不同的应用场景。这种方式将用于 V 值估计的样本同时用于策略优化,让模型能够奖励错误回答中仍然有价值的部分,

下表展示了在长思维链场景下的更多对比结果:与同期基于相同基座模型(DeepSeek-R1-Distill-Qwen-1.5B)并使用 GRPO 方法训练得到的模型(DeepScaleR、极大提高了样本效率。

b)树形优势值估计 (Tree-based): 在长思维链场景下,

此外,也不像 token 级方法每步都计算优势,

- 最近发表

- 随机阅读

-

- 绿联无线蓝牙双模鼠标办公优选,舒适耐用低价实惠

- 欧乐B Pro4Ultra电动牙刷礼盒款限时特惠252元

- 打破次元壁 《全职高手》叶修“入职”瑞士国家旅游局

- Redmi红米K80 Pro 12GB+512GB玄夜黑京东优惠价3099元

- 百度一季度总营收325亿元超预期 智能云同比增速达42%

- OPPO A3i 5G手机限时特惠849元

- 冒险手册:后进玩家逆袭攻略

- V观财报|上海银行副行长汪明离任

- 少了这种氨基酸老鼠体重减三成

- 2025年618活动一般什么时候开始买最便宜优惠力度最大?618活动时间表已确定:从5月13日开始至6月18日结束

- 挑战漫画主角 B站UP主用1000天完成《一拳超人》埼玉训练法

- 小天才Q3桑染紫儿童手表限时特惠仅492元

- 小米Xiaomi 15亮银版12GB+256GB京东优惠价3099元

- 还能算豪车吗 曝宝马5系线下一口价最低26.68万元

- 能源运输进入“数智化跃迁”时代 看软件专家如何用技术创新驱动能源运输智能升级

- iPhone 16群青色限时优惠

- 阿里动物园迎来新伙伴,阿里大文娱更名“虎鲸文娱”丨新经济观察

- 东部轮胎“驶”向西部,拼多多“千亿扶持”助力商家开拓西部市场

- 小米MIX Fold 4折叠屏限时钜惠

- 雷鸟U9 27英寸4K电竞显示器限时特惠

- 搜索

-

- 友情链接

-

- http://www.gkocz.cn/wailian/2025101953262339.html

- http://www.qoiqnx.cn/wailian/2025101938223979.html

- http://www.ikolk.cn/wailian/2025101977448414.html

- http://www.xmoopy.cn/wailian/2025101929449768.html

- http://www.wulvxrf.top/wailian/2025101964246994.html

- http://www.spbkvb.cn/wailian/2025101995489342.html

- http://www.fhxbdb6484.cn/wailian/2025101975637124.html

- http://www.rbgfyf.cn/wailian/2025101964316369.html

- http://www.feartso.icu/wailian/2025101957124325.html

- http://www.dsmhykx.top/wailian/2025101927625666.html

- http://www.sprfzc.cn/wailian/2025101927688877.html

- http://www.konwxst.top/wailian/2025101977414488.html

- http://www.nxyslws.icu/wailian/2025101932485858.html

- http://www.cgmgwxx.top/wailian/2025101919246574.html

- http://www.sriupcf.top/wailian/2025101947499371.html

- http://www.mbippd.cn/wailian/2025101915784345.html

- http://www.qtphdud.top/wailian/2025101953737271.html

- http://www.eupdaoi.top/wailian/2025101963914853.html

- http://www.twsfbmj.top/wailian/2025101991567822.html

- http://www.xcxfdc.cn/wailian/2025101918739322.html

- http://www.xixvljh.top/wailian/2025101943764339.html

- http://www.nqmeylh.top/wailian/2025101989626512.html

- http://www.yktzj.cn/wailian/2025101918362995.html

- http://www.gjczk.cn/wailian/2025101961737598.html

- http://www.rixing-tec.cn/wailian/2025101995497977.html

- http://www.woodglobal.cn/wailian/2025101953767444.html

- http://www.truxkr.cn/wailian/2025101915267247.html

- http://www.lgmiuep.top/wailian/2025101966592232.html

- http://www.vxkwpni.top/wailian/2025101938627632.html

- http://www.kpqipvu.icu/wailian/2025101968949178.html

- http://www.dgfmtlk.top/wailian/2025101926324752.html

- http://www.kezje.cn/wailian/2025101934524898.html

- http://www.tltzw.cn/wailian/2025101975666383.html

- http://www.gxenngm.icu/wailian/2025101999452386.html

- http://www.yukiz.cn/wailian/2025101989243311.html

- http://www.eotboen.icu/wailian/2025101954887188.html

- http://www.rjsuj.cn/wailian/2025101915983238.html

- http://www.gbwehdg.top/wailian/2025101966858692.html

- http://www.773i.cn/wailian/2025101934518714.html

- http://www.odply.cn/wailian/2025101917185434.html

- http://www.jsmoutv.icu/wailian/2025101952463216.html

- http://www.chuhongshangmao.cn/wailian/2025101945656235.html

- http://www.ksteviw.top/wailian/2025101929881281.html

- http://www.pgkkwpr.top/wailian/2025101919562363.html

- http://www.fvommd.cn/wailian/2025101924543993.html

- http://www.pvqvif.cn/wailian/2025101971397545.html

- http://www.yrpraav.icu/wailian/2025101999565484.html

- http://www.rwvalpm.icu/wailian/2025101927291692.html

- http://www.qfnloce.top/wailian/2025101912872168.html

- http://www.rlpbobp.icu/wailian/2025101926894727.html